幻城网安公益大模型API中转站使用教程

欢迎使用幻城网安科技有限责任公司搭建的免费公益大模型 API 中转站!本中转站基于开源 NewAPI 搭建,为大家提供免费、统一的大模型 API 调用服务,支持 195 + 种主流大模型,完全免费无门槛使用。

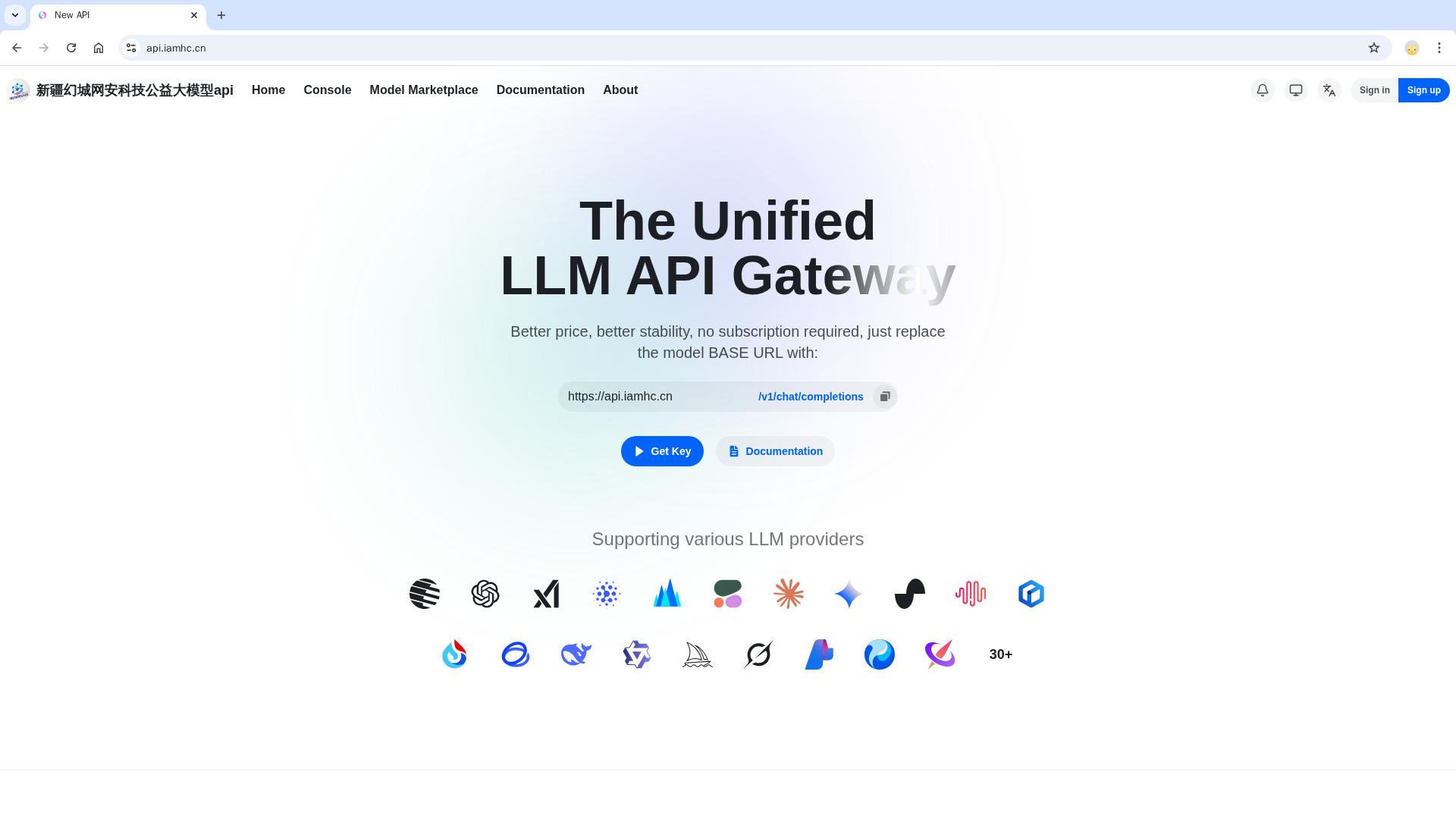

首先打开浏览器,访问我们的中转站地址:

| Plain https://api.iamhc.cn |

访问后你会看到如下的站点首页,这里展示了我们支持的各类大模型厂商,以及基础的调用说明。

点击页面右上角的Sign in按钮,进入登录页面。

如果没有账号密码的可以先通过这里进行注册,注册完毕之后再进行登陆

在登录页面中,输入我们提供的统一账号密码:

- 1用户名 / 邮箱:

- 1密码:

然后勾选I have read and agree to User Agreement and Privacy Policy协议框,点击Continue按钮即可完成登录。

登录成功后,你会进入后台控制台页面,这里可以查看你的账户信息、使用统计等内容。

由于是公益,我们的账户提供了无限的使用额度,你可以放心使用所有模型,无需担心费用问题。

要调用 API,你首先需要获取你的 API 令牌(也是 API Key),这是调用接口的身份凭证。

点击左侧菜单栏中的Token Management(令牌管理)选项,进入令牌管理页面。

在页面中,你可以看到我们已经为你创建好了可用的令牌,其中新疆幻城网安科技有限责任公司这个令牌是你可以使用的 API 密钥。

点击 Key 列的眼睛图标,可以查看完整的 API 密钥,然后点击旁边的复制按钮,可以把密钥复制下来备用。

| 注意:请妥善保管你的 API 令牌,不要泄露给他人,避免被他人盗用。 |

我们的中转站支持 195 + 种主流大模型,覆盖了 GPT 系列、通义千问、Claude、DeepSeek、Llama 等几乎所有主流的大模型,你可以点击顶部导航栏的Model Marketplace(模型市场)查看所有可用的模型。

所有模型都是完全的,你可以根据自己的需求选择合适的模型。

由于目前使用平台的用户较多,服务器负载较高,我们建议:

普通日常任务:优先选择小参数模型,比如qwen3.5、mimmax2.5、kimi k2.5、glm4.7等,这些模型响应速度更快,体验更好。

复杂大任务:如果需要大模型的能力,可以选择nvidia/nemotron-3-super-120b-a12b、gpt-120b-oss等大模型,不过这些模型响应速度会相对慢一些,请耐心等待。

如果你不会写代码,也可以直接使用我们的在线测试功能,无需任何开发知识,直接在浏览器里能和大模型对话。

点击左侧菜单栏中的Playground选项,进入在线测试页面。

在左侧的模型配置中,选择你想要使用的模型。

在右侧的输入框中,输入你想要问的问题,点击发送按钮,可以和大模型对话了。

这个页面支持多轮对话,也支持调整模型的参数(比如 Temperature、Top P 等),你可以根据自己的需求调整。

如果你是开发者,想要在自己的程序中调用我们的 API,非常简单!我们的中转站完全兼容 OpenAI 的接口格式,你只需要把原来的 OpenAI 的接口地址换成我们的地址,API Key 换成我们的令牌,其他的代码完全不需要修改!

API Base URL:https://api.iamhc.cn/v1

API Key:你在令牌管理页面复制的那个密钥(比如sk-kvd7********ykAe)

你可以使用 OpenAI 的 Python SDK 来调用,只需要修改 base_url 和 api_key 即可:

| python import openai# 配置我们的中转站地址和你的API密钥 client = openai.OpenAI( base_url=”https://api.iamhc.cn/v1″, api_key=”你的API密钥,替换成你自己的” )# 调用聊天接口 response = client.chat.completions.create( model=”qwen3.5″, # 你想要使用的模型名称,比如这里用通义千问3.5 messages=[ {“role”: “user”, “content”: “你好,介绍一下你自己”} ] ) print(response.choices[0].message.content) |

如果你使用 curl 调用,示例如下:

| bash curl https://api.iamhc.cn/v1/chat/completions \ -H “Content-Type: application/json” \ -H “Authorization: Bearer 你的API密钥” \ -d ‘{ “model”: “qwen3.5”, “messages”: [ { “role”: “user”, “content”: “你好,介绍一下你自己” } ] }’ |

如果你使用 Chatbox、OpenAI 客户端、LobeChat 等第三方 AI 工具,只需要在工具的设置中,把 API 地址改成我们的https://api.iamhc.cn/v1,然后把 API Key 换成你自己的令牌,可以直接使用了,完全不需要修改其他内容!

比如在 Chatbox 中,你只需要:

打开设置,找到 API 配置

把 API Host 改成https://api.iamhc.cn

把 API Key 改成你复制的令牌

保存之后,可以正常使用所有模型了!

是的,完全免费,这是我们幻城网安的公益,所有模型都可以,没有任何隐藏收费。

因为目前使用平台的用户比较多,服务器的负载比较高,大模型本身的推理速度也会比小模型慢很多,所以如果是普通任务,建议优先使用小模型,体验会好很多。

可以的,你可以在令牌管理页面,点击Create token按钮,创建自己的新令牌,你可以给令牌设置名称、IP 限制等,方便你管理不同的应用。

支持的,我们的接口完全兼容 OpenAI 的流式响应,你可以像使用 OpenAI 的接口一样使用流式响应,实现打字机效果。

支持的,我们支持多模态模型,比如 GPT-4V、Qwen-VL 等,你可以像正常调用一样传入图片 URL,可以实现图片理解的功能。

如果在使用过程中遇到任何问题,欢迎联系我们的团队反馈,我们会尽力为你解决问题,也欢迎你把这个公益中转站分享给有需要的朋友!

暂无评论内容