为满足不同用户需求,平台提供多套餐服务,现各套餐支持的模型列表及服务规则说明如下,请用户根据需求选择合适的套餐。

注意:下面所说模型会有些许变动,但会有可能无法及时同步到本篇文章内,请以实际模型,广场模型为准,最终解释权归本站所有,如需体验付费套餐,本站长劝告:挣钱来之不易,消费请谨慎,确定自己有需求再进行购买,一经付款除特殊情况概不支持退款

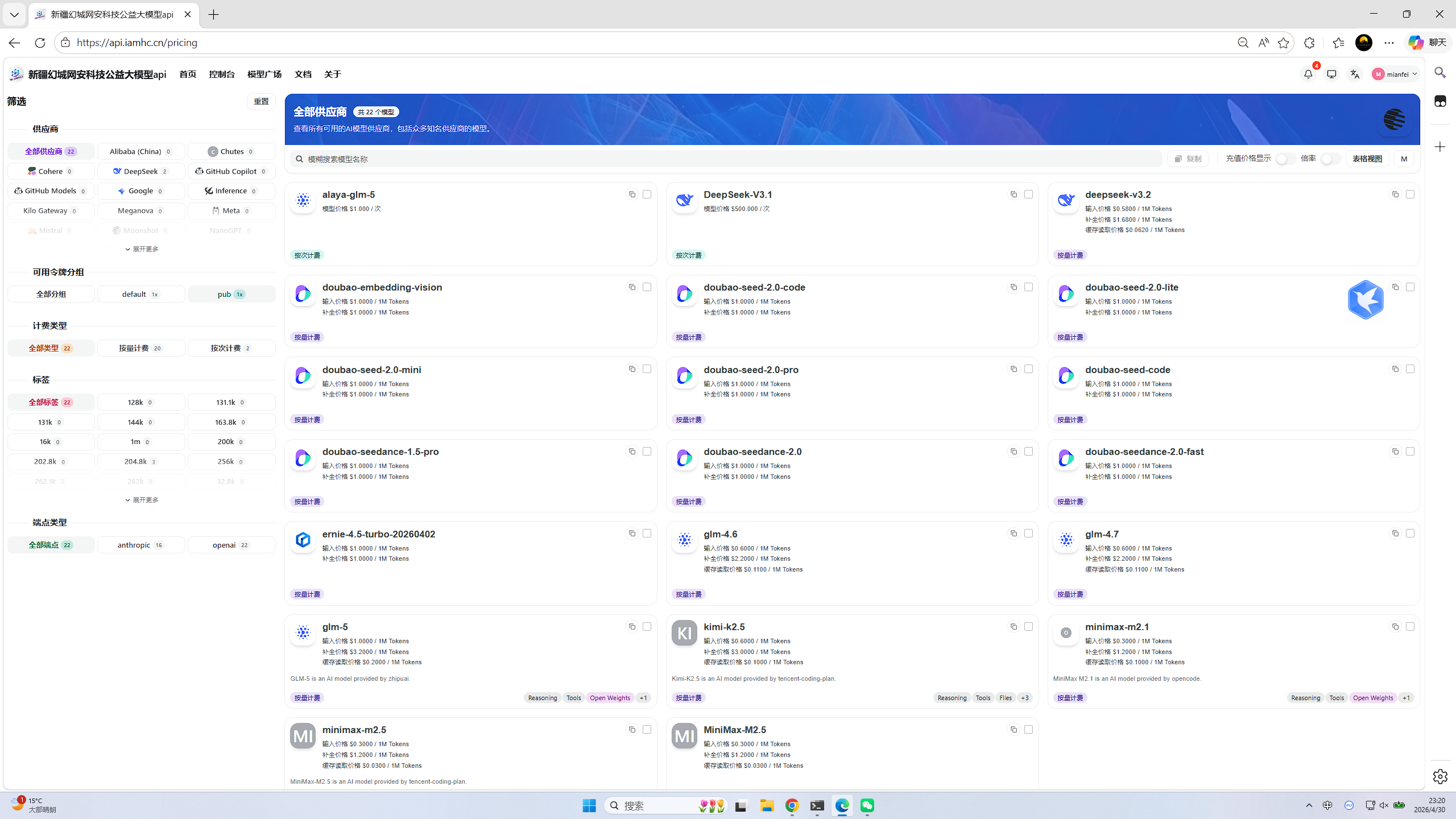

- Qwen3-235B-A22B

- Qwen3.5-397B-A17B

- alaya-glm-5

- DeepSeek-V3.1

- deepseek-v3.2

- ernie-4.5-turbo-20260402

- glm-4.6

- glm-4.7

- glm-5

- kimi-k2.5

- minimax-m2.1

- minimax-m2.5

- sensenova-6.7-flash-lite – 商汤科技(中国)

- sensenova-u1-fast – 商汤科技(中国)

- step-3.5-flash – 阶跃星辰(中国)

- step-3.5-flash-2603 – 阶跃星辰(中国)

- step-image-edit-2 – 阶跃星辰(中国)

- step-router-v1 – 阶跃星辰(中国)

- stepaudio-2.5-asr – 阶跃星辰(中国)

- stepaudio-2.5-tts – 阶跃星辰(中国)

- kat-coder-pro-v2 – 快手(中国)Kwaipilot 团队

- auto (自动模型路由)

- (注:上述模型均属于pub套餐支持范围,具体使用规则详见服务说明)

Svip另外新增加gpt5.4 5.5等满血模型,但是有时会不稳定下架,尽量保证稳定!!svip支持一些国外的模型。

- gpt-5.2 – OpenAI(美国)

- gpt-5.3-codex – OpenAI(美国)OpenAI

- gpt-5.3-codex-spark – 第三方优化版本(基于 OpenAI GPT-5.3-Codex)

- gpt-5.4 – OpenAI(美国)

- gpt-5.4-mini – OpenAI(美国)

- gpt-5.5 – OpenAI(美国)OpenAI

- gpt-image-2 – OpenAI(美国)

上面这几个国外的模型是s vip及以上才支持的。 VIP模型是以下这些。

- alaya-glm-5 – 第三方微调版本(基于智谱 AI GLM-5)

- astron-code-latest – 科大讯飞(中国)

- auto – 通用模型路由功能(各 AI 平台均有实现)

- DeepSeek-V3.1 – 深度求索(中国)

- deepseek-v3.2 – 深度求索(中国)

- deepseek-v4-flash – 深度求索(中国)

- DeepSeek-V4-Flash – 深度求索(中国)

- DeepSeek-V4-Pro – 深度求索(中国)

- ernie-4.5-turbo-20260402 – 百度(中国)

- glm-4.5 – 智谱 AI(中国)

- glm-4.5-air – 智谱 AI(中国)

- glm-4.6 – 智谱 AI(中国)

- GLM-4.7 – 智谱 AI(中国)

- glm-4.7-flash – 智谱 AI(中国)

- GLM-4.7-Flash – 智谱 AI(中国)

- glm-5 – 智谱 AI(中国)

- GLM-5 – 智谱 AI(中国)

- glm-5.1 – 智谱 AI(中国)

- GLM-5.1 – 智谱 AI(中国)

- kat-coder-pro-v2 – 快手(中国)Kwaipilot 团队

- kimi-k2.5 – 月之暗面(中国)

- Kimi-K2.5 – 月之暗面(中国)

- Kimi-K2.6 – 月之暗面(中国)

- minimax-m2.1 – 稀宇科技(中国)

- minimax-m2.5 – 稀宇科技(中国)

- MiniMax-M2.5 – 稀宇科技(中国)

- Qwen3-235B-A22B – 阿里巴巴(中国)通义千问团队

- Qwen3-Coder-Next – 阿里巴巴(中国)通义千问团队

- Qwen3-VL-Embedding-8B – 阿里巴巴(中国)通义千问团队

- Qwen3.5-122B-A10B – 阿里巴巴(中国)通义千问团队

- Qwen3.5-35B-A3B – 阿里巴巴(中国)通义千问团队

- Qwen3.5-397B-A17B – 阿里巴巴(中国)通义千问团队Qwen

- Qwen3.6-35B-A3B – 阿里巴巴(中国)通义千问团队

- sensenova-6.7-flash-lite – 商汤科技(中国)

- sensenova-u1-fast – 商汤科技(中国)

- step-3.5-flash – 阶跃星辰(中国)

- step-3.5-flash-2603 – 阶跃星辰(中国)

- step-image-edit-2 – 阶跃星辰(中国)

- step-router-v1 – 阶跃星辰(中国)

- stepaudio-2.5-asr – 阶跃星辰(中国)

- stepaudio-2.5-tts – 阶跃星辰(中国)

除以上模型外,我们还在积极的不断增加新的模型。让大家享受到更好的体验。

一分钱不充的用户支持的模型列表请自行去模型广场查看,建议使用auto自动路由

虽然说有一些旗舰模型性能非常的强大,例如glm系列等等,但是我依旧建议大家不要扎堆去选择这款旗舰模型,而是要根据自己的实际情况和实际应用场景,去选择不同的模型,以给最好的体验,下面我给出一些建议。 1.遇事不决选择Qwen3.5-397B-A17B系列模型,万金油模型,干什么都行,中不溜,没明显优点,也没缺点 2.强有力的编码的任务,非常强的编码任务,请选择glm-5.1,但是由于该模型限流比较严重,高峰期内可能会出现严重的限流问题,只建议非常重要的任务使用该模型。 3.超大型调用,高频调用(例如养虾,养马,请使用minmax系列模型,或者qwen3.5和3系列小参数模型 4.前端开发,视觉效果要求非常高请选择kimi k2.5和2.6系列模型 5.超长上下文,强后端,请选择deepseek和小米系列模型 6.语言理解,请选择百度模型

温馨提示:请根据使用场景选择套餐,若需高稳定性或优先响应,建议升级至付费套餐。如有疑问,请联系客服咨询详情。

暂无评论内容